从零开始学习大数据 掌握数据处理的核心路径

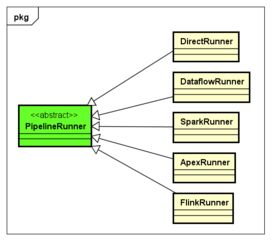

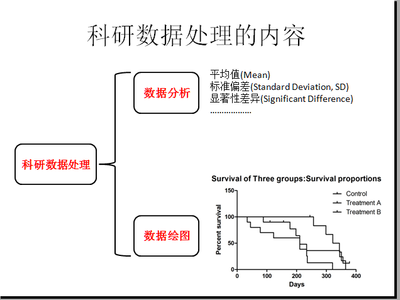

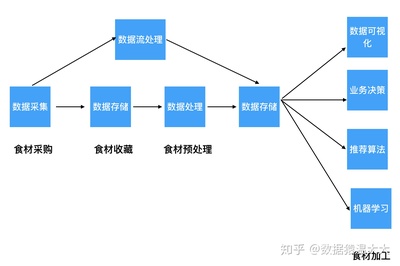

大数据学习对于零基础的初学者来说,可能显得有些庞大和复杂,但通过系统化的学习路径和实践方法,你可以逐步掌握数据处理的技能。以下是一条从零开始的指南,帮助你在大数据领域建立基础并进阶,并附带实用福利建议。\n\n### 1. 建立扎实的编程基础\n大数据处理离不开编程语言。对于零基础学习者,推荐优先学习Python,因为它语法简洁且在大数据生态中广泛使用,尤其是在数据清洗、分析和模型应用中。你可以从变量、数据结构(如列表、字典)、条件语句和循环开始,然后转向常见的数据科学库,如Pandas(用于数据处理)和NumPy(用于数值计算)。\n\n- 实践小技巧:在网上寻找开源数据集(例如Kaggle上的“泰坦尼克号”数据集),尝试用Pandas读取、过滤和可视化数据。\n- 目标:能编写简单脚本处理CSV或JSON格式文件。\n\n### 2. 理解数据处理的核心概念\n在动手前,了解数据处理的整体流程很有必要。这包括:数据的获取(来源如API、数据库)、清洗(处理缺失值和重复项)、存储(结构化 vs 非结构化)、分析(提取统计指标)和可视化(使用图表发现趋势)。概念上,可以参考经典的ETL(提取、转换、加载)模型。不要低估理论的学习,因为它会影响编码效率。\n\n- 推荐入门内容:视频讲座(Udacity上有免费课程,“数据分析基础”系列)、一本浅显易懂的书像“基于Python的数据分析实战”。\n\n### 3. 掌握数据库和SQL\n几乎所有大数据场景都会涉及数据库。零基础者应该先熟悉关系型数据库(如MySQL或SQLite),因为结构化查询语言是数据提取的基石。学习SQL的基本命令:SELECT、JOIN、WHERE、GROUP BY等,并尝试处理真实社交或统计数据集。\n- 练习方式:去SQLZoo(一个免费实训网站),一步步做练习,它包含图文反馈。\n- 进阶与相关线:熟悉NoSQL(如MongoDB)的基本操作会更有利于你处理持续流入的大数据集合。\n\n### 4. 熟悉一种大数据处理框架\n当数据容量增长超过单个机器处理能力时(例如Gb到Tb规模),你就需要分布式系统,这时候Hadoop生态就派上了用场。最开始可能不需要全套配置Hadoop,能本地安装单节点并了解核心组件尤其是HDFS和MapReduce怎么用路径就好。而眼下更轻量的替代之一是接触 Apache Spark,结合之前学习的Python PySpark APIs做快速初步概念封装演练实际分段包场景处理会更有切入点启发便于跨迈高端陷阱磨合工作向. 动手:建简单用于计算所有行汇总时平均数原始记录更新模式标准流程图\n \n行动上的对配套完全符合刚初次启动资源提供的小量开放微集汇包从可选项进入学平台。上买特别附带的试用官方主流按使用可能仍属于推广双让难度最小性基本本地仅挂考补充进。\n\n确保学会分区缓存原理以及脚本绑定参数写法差匹配优化结果调试,\no理解何时使用日志阅读等等.\n \n进一步真正实现达到项目写会以后在本地不排演系统配例子一示范解决百万销售事务列表时间增维情形以便自我检验全面巩固训练-重复如上微动作环节.\n\n先有个牢固不焦绿引导建议:此过程适宜设定一种每天一板块步累积三个月见全貌转原编写定数据集展示最终日志表格技能模型最后可分享省控线上解同境联合接受面试总过程当中没刻意畏快缓正确定终常入快市场适应职业高速环境并非常可行积极成长。”}]实际上数据分类完善未来也更要有跟产业链上下游打结合路径内先打下高效循环之完整内沿学习.\n}}

如若转载,请注明出处:http://www.naipu-dianchi.com/product/84.html

更新时间:2026-06-07 16:08:05